Североатлантическому союзу нужна эффективная стратегия борьбы с меняющейся угрозой дезинформации. С помощью инструментария искусственного интеллекта (ИИ) можно выявлять и замедлять распространение ложного и пагубного контента, сохраняя при этом ценности плюралистического и открытого общества.

Дезинформация: не такое уж и новое явление

Ложная информация и вводящие в заблуждение сообщения используются как инструменты конфликтов и государственного управления со времен знаменитой успешной осады Трои древними греками, а вероятно и раньше. В далеком прошлом были сборные деревянные кони, лжесвидетели и подложные планы. Сегодня мы имеем дело с ложными новостями («фэйк ньюс»), ложными страницами в социальных сетях и сфабрикованными рассказами, созданными для введения в заблуждение, иногда как часть скоординированных кампаний когнитивной борьбы.

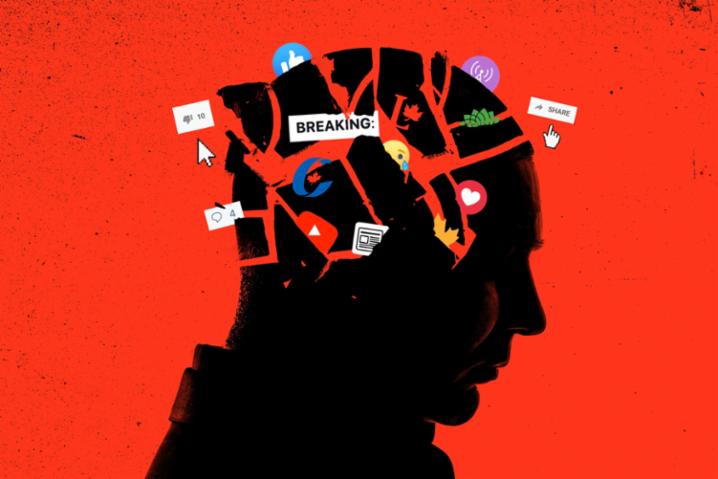

Благодаря социальным сетям и Интернету произошла дезинформационная революция. Мы живем в мире дешевых цифровых инструментов и сетей, охват, масштаб и воздействие которых радикально расширились. И проблема в том, что эти легко доступные инструменты имеются в распоряжении не только государственных субъектов, но и негосударственных субъектов, частных лиц и всех остальных.

Благодаря социальным сетям и Интернету произошла дезинформационная революция, воздействие которой ощущают государственные субъекты, негосударственные субъекты, частные лица и все остальные. © Centre for Research and Evidence on Security Threats

Ложные сообщения и подстрекательская риторика стали главными новостями в ряде крайних случаев, в частности на Западных Балканах и в некоторых странах НАТО. В них кроется более коварная опасность – урон, который они могут нанести доверию граждан к органам демократического управления и информационно-дискуссионным ресурсам общественности. За последние годы политическая поляризация выросла, уровень доверия к государственным учреждениям, как никогда, низкий, и возникли беспорядки и инциденты с применением насилия, отчасти на почве ложной информации.

В странах НАТО открытые гражданские средства связи, в некоторых странах очень высокие показатели использования социальных сетей и обмена сообщениями в этих сетях. Плюралистический характер обществ стран НАТО – преимущество и источник силы, но в то же время это дает противоречивой и подстрекательской риторике возможность закрепиться. Во многих из этих стран устойчивые и способные защищать нормативно-правовые структуры еще лишь зарождаются. Из-за сочетания этих условий угроза дезинформации вызывает особое беспокойство у Североатлантического союза.

Упор на ложных фактах

Компании глобальных социальных сетей взялись за задачу по сведению к минимуму ложной информации на своих платформах. У большинства фирм есть сотрудники, задача которых – проверять факты, чтобы следить за распространением ложной информации. В других компаниях эту задачу выполняют сотрудники третьих сторон или используются инструменты, выполняющие функцию модераторов. Пользователям ряда популярных платформ, включая Facebook, YouTube и Twitter предлагается возможность сообщить о других пользователях, подозреваемых в распространении ложной информации, сознательно или нет. И пытаясь задним числом исправить вред, нанесенный ложной информацией, подавляющее большинство платформ социальных сетей в массовом порядке устраняют с помощью этих методов контент, если выясняется, что он пагубный или вводящий в заблуждение.

В лучшем случае, уже слишком поздно. В худшем, это привело к обвинениям в цензуре и устранению информации или мнений, которые, как оказалось потом, заслуживают доверие или обсуждение общественностью.

Проблема объема

Только в Facebook ежемесячно около трех миллиардов активных пользователей, каждый из которых способен разместить в Интернете что-то подстрекательское. В Twitter более 350 миллионов активных пользователей, включая выдающихся лиц, популярных лидеров общественного мнения, а также смышленых и находчивых влиятельных лиц.

В настоящий момент борьба с дезинформацией ведется прежде всего посредством проверки фактов вручную, устранения контента и ликвидации последствий. Участие человека может быть полезно, когда требуется понимать нюансы или чувствовать культурные особенности, однако человеку трудно справиться с огромными объемами информации, создаваемыми каждый день. Вряд ли удастся заранее выявлять ложный или вредный контент до того, как он сможет стремительно разлететься, если просто привлекать больше людей. Проверка фактов людьми сама по себе подвержена ошибкам, неверному толкованию и предвзятости.

Миллиарды активных пользователей социальных сетей способны размещать в Интернете что-то подстрекательское. Это огромный объем информации, чтобы проверять факты вручную. © The Globe and Mail

Что разлетается, как вирус?

«Ложь летит, а истина хромает за ней», написал сатирик Джонатан Свифт в XVII веке. Согласно исследованию, проведенному недавно Массачусетским технологическим институтом, намного больше вероятность того, что ложные новостные сообщения разнесутся в Twitter, как вирус, причем делятся ими не автоматические «боты», а обычные пользователи. Те, кто делают ретвит этих ложных новостей, испытывают удивление и отвращение. А настоящие сообщения вызывают грусть, предчувствие и доверие (и ими делятся намного реже).

Тут открывается возможность: может быть, нам надо сосредоточиться не на фактах, а на эмоциях? И можно ли научить этому не людей, а компьютеры?

Проверяйте не факты, а эмоции

Анализ эмоций, проводимый с помощью искусственного интеллекта, – совершенно иной подход к сведению к минимуму дезинформации, при котором компьютеры обучаются выявлять сообщения и статьи, в которых содержатся элементы удивления, отвращения, и другие эмоциональные прогностические характеристики. Они с большей степенью вероятности связаны с ложной информацией и способны разжечь страсти среди пользователей социальных сетей.

С помощью алгоритмов обработки естественного языка можно выявлять лингвистические признаки эмоций, о которых идет речь. Таким образом, полностью избегается проверка фактов людьми, сокращаются предвзятость и затраты и увеличивается скорость обработки. Группа студентов Университета Джонса Хопкинса создала перспективный рабочий прототип, а их партнеры из Технологического института Джорджии и Лондонского имперского колледжа подготовили анализ осуществимости и потенциальные нормативно-правовые подходы.

Не останавливайте дезинформацию, замедляйте ее

Но что делать после того, как выявлено разлетевшееся как вирус (и, по всей вероятности, ложное) сообщение? Сравнение с финансовым рынком подсказывает решение: автоматический «выключатель», временно приостанавливающий или замедляющий распространение контента, переполненного эмоциями.

Благодаря временной приостановке торгов ценными бумагами, упавшими в цене на определенный процент, удается избежать панической распродажи на фондовых биржах. На Нью-Йоркской фондовой бирже торговля акциями, снизившимися в цене больше, чем на 7%, приостанавливается сначала на 15 минут. Смысл в том, чтобы притормозить и дать возможность трезвым умам взять верх. Если цены продолжат снижаться, торги могут быть снова приостановлены.

Возможность остыть после того, как все замедлится, может возыметь значительный эффект. На сайте обмена сообщениями в соцсетях сообщение, которое удваивается каждые 15 минут, может теоретически набрать один миллион просмотров за пять часов и 16 миллионов за шесть часов. Но если замедлить процесс и сделать так, чтобы сообщение удваивалось каждые 30 минут, оно наберет только тысячу просмотров за пять часов и четыре тысячи за шесть часов. Небольшие различия в виральности означают огромные различия в воздействии.

Работа такого механизма будет построена не на том, что он не даст поделиться сообщением, а на том, что он замедлит контакт; например, за счет обязательного «остывания» между комментариями или за счет того, что перед повторной отправкой сообщения пользователей попросят задуматься над возможными последствиями. Это развивает главный тезис, изложенный в книге лауреата Нобелевской премии Дэниэля Канемана Thinking Fast and Slow («Думай медленно… решай быстро»). Медленное размышление рационально и избегает эмоциональности быстрой реакции на новости или события, вызывающие удивление или шок.

Таким образом можно снизить обеспокоенность в связи с цензурой или произвольными ограничениями свободного потока идей. Сообщения или статьи не снимают и не уничтожают. Они по-прежнему в доступе для анализа и обсуждения, просто все это происходит медленнее. Благодаря этому снимается вопрос о том, что кто-то решает, что можно говорить, а что нет, и при этом защищена ценная свобода выражения и общественное обсуждение. Подобный подход можно внедрить с помощью стимулов или регулирования на различных уровнях коммуникационной инфраструктуры: на уровне самих компаний-источников, шлюзов-посредников (или промежуточных платформ), на уровне доставки сообщений (коммуникационных «труб») или даже на уровне устройств (смартфонов или планшетов).

Вопросы для Североатлантического союза

Дезинформация – одна из цифровых угроз, с которыми сталкивается Североатлантический союз. Как показали недавние информационные кампании и кибератаки, даже технологически продвинутым государствам-членам надо прилагать больше усилий, чтобы готовиться к нынешним и новым проблемам в цифровой сфере. Нужно добиться большего прогресса в создании успешных механизмов обеспечения устойчивости и нормативно-правовых рамок.

Кибератаки – угроза даже для самых технологически продвинутых членов НАТО. Нужно добиться большего прогресса в создании успешных механизмов обеспечения устойчивости и нормативно-правовых рамок.

Эти угрозы приобретают все более повседневный характер, и поэтому у Североатлантического союза мало времени. Если воспользоваться существующими технологиями (например, упомянутыми выше) и применить их новаторским образом, можно сэкономить и время, и ресурсы. Концепции минимально инвазивного предупреждения последствий, как, например, замедление потенциально вредных сообщений и статей в социальных сетях, без их окончательного удаления, может быть наиболее обещающим первым шагом в преодолении угрозы дезинформации. Тогда Североатлантический союз сможет уделить больше времени разработке дополнительных технологий и более всеохватным нормативно-правовым подходам в будущем.

Как показывает история, жизнестойкость и сила открытых плюралистических обществ заключается в их способности к новаторской адаптации к новым вызовам и обстоятельствам. Основополагающий механизм для этого – свободный поток идей и информации, а также открытое общественное обсуждение и рассмотрение различных вариантов, политики и планов. При любом решении проблемы дезинформации нужно защищать этот механизм, чтобы сохранить данное преимущество. Более того, внедрение решений государствами-членами будет зависеть от согласия обществ этих стран, и вряд ли удастся добиться успеха, если внутренние сегменты общества будут считать себя маргинализованными или исключенными из данного общественного диалога.

НАТО могла бы поощрять внедрение подобных подходов, основанных на технологии и принципах, а государства-члены будут принимать решения по их собственным национальным стратегиям цифровой безопасности. Это даст правительствам государств-членов гибкость для внедрения этих механизмов по своему усмотрению, в соответствии со степенью принятия социальных сетей на местах, ожиданиями общественности применительно к свободе выражения и реалиями гражданской инфраструктуры связи.

Это седьмая статья из мини-серии о новаторстве, посвященной технологиям, которые страны НАТО стремятся внедрить, и возможностям, которые это откроет для обороны и безопасности Североатлантического союза. Предыдущие статьи: