Zastępca szefa Jednostki ds. Innowacji (Innovation Unit) w Pionie Rodzących się Wyzwań Bezpieczeństwa (Emerging Security Challenges Division – ESCD) przedstawia aktualny stan wysiłków zmierzających do wypracowania polityki NATO w dziedzinie sztucznej inteligencji.

Jak stwierdzono w pierwszym artykule w tej serii dotyczącej innowacji w NATO, ma ono obecnie do czynienia z globalnym wyścigiem w obszarze wdrożeń technologii. Rywalizujące ze sobą mocarstwa posługują się nowymi technologiami, aby realizować podwójny cel podnoszenia konkurencyjności ekonomicznej i zwiększania zdolności wojskowych. Członkowie Sojuszu zmagają się z całą gamą wyzwań związanych z próbami wykorzystania rodzących się i przełomowych technologii. Wyzwania te są pokonywane w ramach dwóch powiązanych ze sobą ścieżek działania – poprzez zapewnienie dynamicznego wdrażania nowych technologii oraz dzięki odpowiedniemu zarządzaniu tymi technologiami. Sztuczna inteligencja (SI) jest w samym centrum tych rozważań.

Sztuczna inteligencja to zdolność maszyn do wykonywania zadań, które zwyczajowo wymagają ludzkiej inteligencji, takich jak rozpoznawanie schematów, uczenie się z doświadczeń, wyciąganie wniosków, przewidywanie lub podejmowanie działania – czy to cyfrowo, czy wykorzystując zaawansowane oprogramowanie wspierające autonomiczne fizyczne systemy (zobacz: Science & Technology Trends 2020-2040 – Exploring the S&T Edge).

Zgodnie z sugestią think tanku RAND zawartą w raporcie The Department of Defense Posture for Artificial Intelligence: Assessment and Recommendations (2019), pomocne jest rozróżnienie trzech szerokich typów zastosowań – są to SI w przedsiębiorstwie (Enterprise AI), SI wspierającą misje (Mission Support AI) oraz SI operacyjna (Operational AI).

SI w przedsiębiorstwie obejmuje zastosowania takie, jak systemy finansowe i kadrowe z obsługą SI, wdrażane w ściśle kontrolowanych warunkach, gdzie skutki usterek technicznych są niewielkie (w kategoriach natychmiastowego zagrożenia oraz potencjalnej śmiercionośności).

Operacyjna SI, dla kontrastu, może być rozmieszczana na misjach i podczas operacji, to jest w znacznie mniej kontrolowanych warunkach i takich, gdzie skutki awarii technicznej mogą być krytycznie poważne. Przykładem jest między innymi sterujące oprogramowanie systemów stacjonarnych lub systemów pojazdów bezzałogowych.

SI wspierająca misje - kategoria pośrednia, jeśli chodzi o kontrolę warunków i skutków awarii, obejmuje zróżnicowany zbiór zastosowań, na przykład w logistyce i konserwacji sprzętu, albo w zastosowaniach związanych z wywiadem.

Takie rozróżnienie może okazać się użyteczne do określania priorytetów zarówno w zakresie polityki wdrażania, jak i zasad użytkowania, z uwzględnieniem różnych poziomów ryzyka przypisanych do tych kategorii.

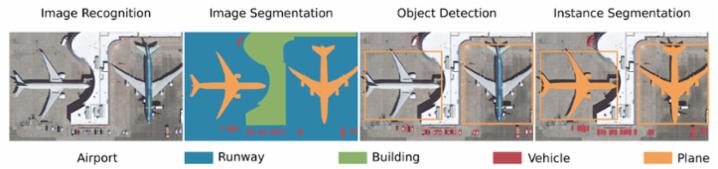

Aktualna fala SI (druga fala sztucznej inteligencji) koncentruje się na uczeniu maszynowym. Uczenie maszynowe obejmuje tworzenie i stosowanie algorytmów statystycznych umożliwiających odkrywanie schematów danych. Na przykład algorytm klasyfikujący może być uczony na dużym zbiorze poprawnie określonych przykładów, tak aby rozpoznawał, do której wcześniej napotkanej kategorii (klasy decyzyjnej) przypisać nowo zaobserwowane obiekty. Głębokie uczenie (Deep Learning) jest podzbiorem uczenia maszynowego, który stosuje wielorakie poziomy przetwarzania danych (wielopoziomowe sztuczne sieci neuronowe) do obsługi wymagającego pod względem obliczeniowym rozpoznawania schematów lub przewidywania problemów, na przykład konwolucyjne sieci neuronowe (Convolutional Neural Network - CNN) do detekcji obiektów w obrazach. Poniższa Grafika 1 ilustruje głębokie uczenie w celu rozpoznawania samolotów, pojazdów i budynków w obrazach.

Głębokie uczenie (Deep Learning) może być wykorzystane do detekcji konkretnych obiektów w obrazach.

(Źródło: Hoeser, T.; Kuenzer, C. Object Detection and Image Segmentation with Deep Learning on Earth Observation Data: A Review-Part I: Evolution and Recent Trends. Remote Sens. 2020, 12, 1667.)

Maszynowe uczenie bardzo dobrze sprawdza się na dużych zbiorach precyzyjnych danych, a działa słabo na małych zbiorach danych lub zbiorach zawierających nieprecyzyjne dane. W dobrych warunkach w szerokiej gamie zastosowań uczenie maszynowe pokonuje człowieka zarówno pod względem wyników przewidywania, jak i szybkości procesu, co zbadano w rosnącym spektrum zadań związanych z rozpoznawaniem wąskich schematów i przewidywaniem. To podstawowy powód coraz intensywniejszego wdrażania technik maszynowego uczenia w szerokich obszarach ludzkiej działalności.

W kierunku dynamicznego wdrażania

Tradycyjnie ekonomiści modelowali produkt wyjściowy jako funkcję pracy i kapitału (czynniki produkcyjne) oraz wkładu materiałowego. W przypadku sztucznej inteligencji czynniki produkcyjne, to wysoko specjalistyczny talent oraz infrastruktura niezbędna dla technologii informacyjno-komunikacyjnych (ICT) do procesów obliczeniowych i przechowywania, a kluczowym produktem wejściowym są dane.

Czy dane są nową ropą naftową? Zasadniczo, nie. Jako że dane muszą być „wydobywane” a następnie „dopracowywane” przed dalszym użytkowaniem, ich dostępność rośnie wraz ze wzrostem produktu wyjściowego. Dane są także konkretnie przypisane, a nie wymienne. Dla każdego konkretnego przypadku zastosowania niezbędne są odrębne zbiory danych ujmujących precyzyjnie istotne obserwacje rzeczywistości (lub symulacji). Aby zapewnić solidny punkt wyjściowy, instytucje obronne państw członkowskich będą musiały zapewnić swoje dalsze ucyfrowienie. Ogólna polityka w zakresie danych musi uwzględniać pełen łańcuch wartości (value chain), obejmujący zbieranie, dostępność, dzielenie się, przechowywanie, metadane, dokumentację, kontrolę jakości (w tym czyszczenie danych i ograniczanie zniekształceń poznawczych), a także procesy mające zapewnić przestrzeganie wymogów prawnych.

Działania wspierające czynniki produkcyjne – talent i infrastrukturę – powinny obejmować rozsądną i elastyczną politykę kadrową i dotyczącą zawierania umów, tak aby przyciągnąć i pielęgnować najlepsze ludzkie talenty, a także rozmieszczanie odpowiednich i bezpiecznych zdolności obliczeniowych i możliwości przechowywania danych.

Następna jest produktywność. Przez wieki podmioty gospodarcze szukały najlepszych sposobów łączenia czynników produkcji – Czy są one komplementarne? Czy są one zastępowalne? Jakie kombinacje przynoszą najwyższe zyski? Jakie procesy produkcji i zarządzania dają najlepsze rezultaty? W przypadku sztucznej inteligencji, chociaż do pewnego stopnia możliwa jest wymiana, czynniki produkcji są znacznie bardziej komplementarne niż zastępowalne. Do osiągnięcia sukcesu potrzebne jest poważne inwestowanie we wszystkie te trzy czynniki.

Jeśli chodzi o procesy i zarządzanie, najlepsze praktyki w branży softwarowej wskazują, że tworzenie i dostarczanie rozwiązań w zakresie sztucznej inteligencji powinno opierać się na zwinnych (Agile) rozwiązaniach bardziej niż na tradycyjnym modelu wodospadowym lub kaskadowym (Waterfall). Wymusza to wysoce dynamiczne i interaktywne procesy, zaczynając od początkowego i elastycznego określenia problemu, zamiast szczegółowego i surowo przestrzeganego stwierdzenia wymogów. Kilka wariantów zwinnych rozwiązań (Agile) istnieje w przemyśle i niektóre z tych wariantów są aktywnie realizowane w pewnych społecznościach NATO.

Zobowiązanie do odpowiedzialnego użytkowania

Sukces Sojuszu w odniesieniu do sztucznej inteligencji będzie też zależał od nowych i dobrze zaprojektowanych zasad i praktyk odnoszących się do dobrego zarządzania i odpowiedzialnego użytkowania. Niektóre rządy państw natowskich podjęły już pewne publiczne zobowiązania w zakresie odpowiedzialnego użytkowania z uwzględnieniem takich pojęć, jak na przykład legalność, odpowiedzialność, niezawodność i zdolność zarządzania.

Równolegle do tego, członkowie NATO wzięli udział w pracach Grupy Ekspertów Rządowych ds. Autonomicznych Śmiercionośnych Systemów Uzbrojenia (Group of Governmental Experts on Lethal Autonomous Weapon Systems) pod auspicjami Organizacji Narodów Zjednoczonych, co doprowadziło do sformułowania 11 wiodących zasad.

Co ważne, są dobre argumenty przemawiające za tym, żeby postrzegać prace nad wdrażaniem sztuczniej inteligencji oraz wypracowywanie zasad odpowiedzialnego użytkowania jako komplementarne i synergiczne. W istocie istnieją pewne elementarne zasady lub cele, które będą podstawą i ułatwieniem zarówno dla kodeksu inżynierów, jak i dla odpowiedzialnego postępowania państw.

Określone zasady narodowe implikują konkretne wymogi w zakresie projektowania. Na przykład, zasada zdolności do zarządzania może być połączona z technicznymi zdolnościami do wykrywania i unikania niezamierzonych konsekwencji oraz do odłączania i dezaktywacji w przypadku niezamierzonego zachowania.

Wspomniane cechy techniczne wymagane do zagwarantowania, że te i inne założenia są spełnione, będą z konieczności elementem faz projektowania i testowania odpowiednich systemów. Z kolei odpowiednie prace inżynieryjne będą szansą do doskonalenia poziomu zrozumienia, co będzie prowadzić do bardziej sprecyzowanych i dojrzałych zasad. Dalsze prace w tym obszarze obejmujące testowanie, ocenę, weryfikację i walidację (TEVV) będą niezbędne, podobnie jak wsparcie w postaci odpowiednich prac nad modelowaniem i symulacją. Dobrze ugruntowane atuty NATO w obszarze standaryzacji pomogą wytyczyć te kierunki działania, jednocześnie zapewniając interoperacyjność pomiędzy siłami Sojuszu.

Tymczasem nadrzędne zasady, na przykład wypracowane w niektórych kontekstach narodowych, a także pod auspicjami ONZ, nakreślą podstawową linię dalszych konsultacji w gronie członków Sojuszu, a także posłużą jako punkty odniesienia dla stanowiska państw.

Jest to drugi artykuł z mini-serii przygotowywanej przez natowski zespół ds. innowacji, która koncentruje się na technologiach rozważanych do wdrożenia przez państwa członkowskie oraz szansach, jakie one przyniosą dla obronności i bezpieczeństwa Sojuszu Północnoatlantyckiego.