Rosnący wykładniczo postęp technologiczny, zwłaszcza w dziedzinie cyfrowej, wpływa na wszystkie obszary życia. Chociaż postęp ten rodzi się głównie w sektorze komercyjnym, doprowadził on do demokratyzacji technologii, które mogą także być przystosowane do użycia jako broń. Rozwój technologii generuje także nowe dylematy dotyczące ich stosowania przez siły zbrojne.

We wrześniu 2017 roku podczas przemówienia do studentów w Moskwie prezydent Władimir Putin wygłosił słynną tezę, iż dowolne państwo, które stanie się liderem w badaniach nad sztuczną inteligencją (SI) „stanie się władcą świata”. Chiny otwarcie obrały sobie taki cel do realizacji na 2030 rok.

Kilka miesięcy później, w swoim orędziu wygłoszonym do członków Dumy, Putin ogłosił, że zakończono testowanie hipersonicznego szybowca i miała rozpocząć się jego produkcja (technologia ta może zasadniczo zredukować czas potrzebny na dotarcie do celu, a szybowiec może przenosić zarówno konwencjonalne, jak i nuklearne głowice).

We wrześniu 2019 roku jemeńscy rebelianci Huti pochwalili się pierwszym znanym skoordynowanym masywnym atakiem roju dronów na dwa zakłady produkcji ropy naftowej w Arabii Saudyjskiej, po pokonaniu saudyjskich systemów obrony powietrznej.

W warunkach najnowszego kryzysu związanego z wirusem COVID-19, pojawiają się kolejne przykłady destrukcyjnego, a nawet wywrotowego oddziaływania psychologicznego operacji (dez)informacyjnych przeprowadzanych poprzez media społeczne – nie mówiąc o szeroko zakrojonych działaniach szpiegowskich opartych na spear phishing (wyłudzaniu poufnych danych przez podszywanie się pod jakąś osobę lub instytucję) lub nawet o bezpośrednich cyberatakach na placówki medyczne.

W skrócie, zarówno na poziomie krajowym, jak i międzynarodowym nowe, potencjalnie destrukcyjne technologie dramatycznie uderzają w metody tworzenia i realizowania polityki w dziedzinie odstraszania, obrony i szerzej – bezpieczeństwa.

Urządzenia wchodzące w skład roju dronów mogą grupowo podejmować decyzje. Ta nowa technologia umożliwia zarówno podmiotom państwowym, jak i niepaństwowym, powodowanie szkód i zniszczeń nie tylko na polu bitwy, ale także wobec ludności cywilnej lub infrastruktury krytycznej. © Medium.com

Technologia i działania zbrojne

Od epoki kamiennej po Hiroszimę, technologia miała głęboki wpływ na działania zbrojne (a czasami przyczyniała się do ich rewolucjonizowania). Z kolei działania zbrojne często napędzały rozwój technologii później wykorzystywanych w życiu cywilnym. Celowe ludzkie majstrowanie w otaczającym świecie w istocie zawsze miało podwójne zastosowanie – od narzędzi służących do polowania- po łodzie, od materiałów wybuchowych po silniki spalinowe, od kolei żelaznej po satelity – podobnie, jak platformy sprzętowe, takie jak rydwany, galery, pojazdy mechaniczne i lotnicze. Inżynieria oparta na naukach ścisłych zawsze wspierała działania zbrojne, od fortyfikacji po artylerię i od łączności po nadzór obserwacyjny. Jednak systematyczna i finansowana przez państwo działalność badawczo-rozwojowa (DBR, R&D) o przeznaczeniu wojskowym rozpoczęła się dopiero podczas II wojny światowej i można powiedzieć, że osiągnęła szczyt podczas zimnej wojny.

Technologia zaprzęgnięta do działania przez sprawnych dowódców zawsze pomnażała siły na wojnie, ponieważ umożliwiała zadawanie większych szkód wrogom i ograniczanie szkód ponoszonych po własnej stronie. Na przestrzeni dziejów przewaga technologiczna zwykle sprzyjała zwycięstwu, ale nigdy go nie gwarantowała. Przeciwnikom dysponującym porównywalną siłą często udawało się wyrównać i przeciwstawić się przewagom taktycznym, nawet przed końcem danego konfliktu, a zdecydowanie słabsi przeciwnicy często (i czasami z sukcesem) reagowali za pomocą „asymetrycznych” taktyk. Innymi słowy, wartość technologii w działaniach zbrojnych jest zawsze uzależniona od zdolności przeciwnika.1

Jednak to, z czym mamy do czynienia obecnie, przynajmniej od lat 90., to wykładniczo rosnący postęp technologiczny, który wpływa na wszystkie dziedziny życia – nie tylko i nie przede wszystkim na sprawy wojskowe. W obszarze odstraszania i obrony rozwój i wdrażanie technologii informacyjno-komunikacyjnych (TIK, ICT) prowadzących do powstania precyzyjnie sterowanych pocisków i tak zwanych sieciocentrycznych działań zbrojnych, pierwotnie były koncepcyjnie określane jako „rewolucja w sprawach wojskowych” (RMA). Wcześniejsze takie rewolucje obejmowały wprowadzenie rydwanów w starożytności, prochu strzelniczego u świtu ery nowożytnej, jednostek zmechanizowanych po rewolucji przemysłowej oraz broni jądrowej po II wojnie światowej (mającej działać jak magiczna różdżka). Jednak obecnie jest oczywiste, że chociaż w obrębie sieciocentrycznych działań zbrojnych obserwuje się szybki postęp, jest on jednak raczej ewolucyjnym i przyrostowym procesem transformacji, a nie prawdziwą rewolucją. Niemniej jednak, nadal ma on w dużej mierze nieprzewidywalne implikacje w odniesieniu do odstraszania, obrony i ogólnie bezpieczeństwa.

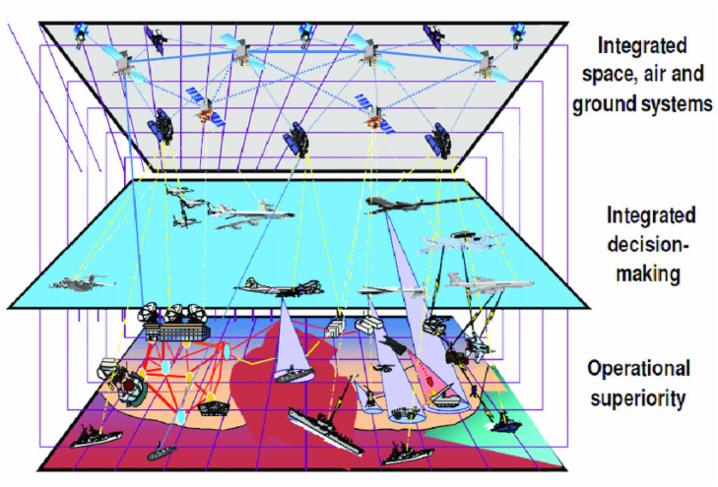

Sieciocentryczne działania zbrojne są pochodną postępów w dziedzinie cyfrowej. Poszczególne platformy są połączone ze współdzielonymi sieciami, co ułatwia wymianę informacji, podnosi świadomość sytuacyjną oraz umożliwia szybkie podejmowanie decyzji i skraca czas reakcji. © Research Gate

Oczekuje się, że dokładnie tak jak poprzednie (r)ewolucje, ta obecna dramatycznie zmieni równowagę (lub równowagi) sił – nie tylko, jak w przeszłości, pomiędzy imperiami, państwami-miastami lub państwami narodowymi, ale także w obrębie i pomiędzy różnymi podmiotami, ponieważ na przykład duże spółki technologiczne zaczynają cieszyć się potęgą i nawet statusem często porównywanym do państwowości. W XXI wieku rzeczywiście obserwujemy wyjątkowe przyspieszenie rozwoju technologicznego – przede wszystkim dzięki sektorowi komercyjnemu i zwłaszcza w obszarze cyfrowym. Dzięki temu tworzy się coraz ściślejsza sieć łączności działająca niemal w czasie rzeczywistym we wszystkich obszarach aktywności społecznej o bezprecedensowej skali i tempie funkcjonowania. W rezultacie, natychmiast dostępne nowe technologie, sprytnie razem stosowane i łączone, oferują zarówno podmiotom państwowym, jak i niepaństwowym szeroką gamę nowych narzędzi do zadawania szkód i zniszczeń przewyższających i wykraczających poza to, co było możliwe do wyobrażenia kilka dekad temu, nie tylko w odniesieniu do tradycyjnie potężniejszych sił zbrojnych na polu bitwy, ale także wobec ludności cywilnej i infrastruktury krytycznej.

Co więcej, w większość technologie te – może z wyjątkiem systemów stealth i hipersonicznych – są produktem ekosystemów diametralnie różnych od tradycyjnych obiektów lub kompleksów przemysłowo-obronnych opartych na hierarchicznym, długoterminowym planowaniu zdolności, oligopolistycznym systemie podaży (z wąskim kręgiem sprzedawców z reguły uprawiających konkurencję pozacenową) oraz monopsonistycznym systemie popytu (pojedynczy kupiec). W związku z tym, w przeszłości wojskowe projekty badawczo-rozwojowe prowadziły do powstania technologii – takich jak radary, silniki odrzutowe lub energia jądrowa, które były później adaptowane i komercjalizowane do użytku cywilnego.2 W odróżnieniu od tego, nowe technologie są tworzone oddolnie i bardzo szybko po ich powstaniu są wprowadzane na rynek. Dopiero, gdy trafią do milionów klientów na całym świecie i wytworzą efekt sieciowy, nabierają podwójego zastosowania i dzięki temu mogą być przystosowane do użycia jako broń.

Wektor wynalazków podwójnego zastosowania znacząco się obrócił – ich skutki uboczne, to jest przenoszenie ich na obszary inne niż pierwotnie zamierzony (spillover) oraz tworzenie kolejnych wariantów produktu (spin-off), mają swój początek przede wszystkim w obszarze cywilnym. Inwestycje w naukę i technologię są obecnie napędzane przede wszystkim przez rynki komercyjne, zarówno w wymiarze krajowym, jak i globalnie, a skala ich wydatków daleko przesłania wydatki na naukę i technologię o konkretnie wojskowym przeznaczeniu, co prowadzi do powstania obszarów technologii, w których obronność jest całkowicie uzależniona od rozwoju strefy cywilnej i rynków. Nowe superpotęgi (i „super-influencerzy”) to prywatni komercyjni giganci techniczni z Zachodniego Wybrzeża USA i z kontynentalnych Chin.

Zdalne sterowanie i brak kontroli

Najnowsze przełomy technologiczne w szczególności sprzyjały rozwojowi i demokratyzacji tak zwanej broni dystansowej, to jest broni, która może być wystrzeliwana z odległości wystarczającej atakującym żołnierzom do uchronienia się przed ostrzałem z przeciwnej strony. Delegowanie i outsourcing działań wojskowych oddziałom posiłkowym, najemnikom, korsarzom, rebeliantom lub żołnierzom kontraktowym – ostatnio określane mianem „surogatywnych działań zbrojnych” (surrogate warfare) – to oczywiście nic nowego Jednakże, te nowe technologie kwestionują fundamentalne, choć ukryte kompromisy pomiędzy delegowaniem i kontrolą, i równocześnie generują nowe dylematy, ponieważ umożliwiają zdalną obsługę bezzałogowych platform, początkowo w celu rozpoznania i nadzoru, a następnie także do przeprowadzania misji karnych i dekapitacyjnych. Chociaż nie jest to pierwsze zastosowanie urządzeń jako „pośredników” w działaniach zbrojnych (pociski typu cruise służyły podobnym celom), nowe rodzaje uzbrojenia zapewniają także bezprecedensową dyskrecję (posunięcia mało widoczne, także we własnym kraju) oraz możliwość wypierania się odpowiedzialności, zwłaszcza wobec społeczności międzynarodowej.3

Co najważniejsze, niektóre takie narzędzia są obecnie łatwo dostępne na rynkach komercyjnych oraz stosunkowo proste w obsłudze, co w dalszym stopniu łamie tradycyjny monopol państwa na broń i legalne użycie siły, a także otwiera nowe „przestrzenie” dla innowacyjnych działań zbrojnych. Były już one wykorzystywane w operacjach (anty)terrorystycznych i anty(rebelianckich) zagranicą, ale z łatwością mogą być używane w warunkach miejskich – i mogą być naładowane środkami chemicznymi, biologicznymi i radiologicznymi. W rzeczywistości, dostępność i intencje są kluczowe we wszystkich tych przypadkach, co obniża barierę ich użycia i poszerza ich zasięg.

Ze swej strony broń w cyberprzestrzeni – używana do sabotażu (cyberataków) lub działań wywrotowych (kampanii dezinformacyjnych i destabilizacyjnych) raczej niż w celach szpiegowskich – umożliwia nawet więcej niż wymuszanie siłą i dezorganizację, przy jednoczesnym zachowaniu dyskrecji i wypieraniu się odpowiedzialności. Jest tak dlatego, że narzędzia te działają w środowisku w całości stworzonym przez człowieka i słabo regulowanym, które całkowicie opiera się na wykorzystaniu technologii. Broń cyfrowa może w rzeczywistości osiągać cele strategiczne porównywalne do tych, jakie osiągają działania zbrojne, bez sięgania po bezpośrednią przemoc fizyczną, a tymczasem większość ekspertów uważa cyberwojnę w ścisłym znaczeniu tego słowa za zdecydowanie przesadzony scenariusz. W przeciwieństwie do broni nuklearnej, broń cyfrowa nie służy do odstraszania, ale do rzeczywistego i nawet ciągłego użytku i może być sterowana przez państwa równie dobrze, jak przez „pośredników” i organizacje prywatne, bez ograniczeń prawnych lub geograficznych - atrybucja działań jest trudna, a odwet - ryzykowny.4

Obszar mediów stał się dodatkowym polem bitwy, jako że stanowi on obecnie ponadnarodową, globalną strefę publiczną, gdzie postrzeganie słuszności i jej braku, zwycięstwa i porażki (tak zwany „efekt publiczności”)5 jest kształtowane i utwierdzane z prędkością światła. Media społecznościowe może i nie zostały zmilitaryzowane – chociaż żołnierze rzeczywiście często ich używają, co naraża je na wrogie działania – ale z pewnością zostały przystosowane do użycia jako broń. Ta nowa gra nazywa się wykorzystanie „broni o otwartym kodzie źródłowym”6, w której indywidualni obywatele i konsumenci często działają jako mniej lub bardziej nieświadomi pomocnicy. De facto, chociaż sabotaż cyfrowy wymaga większego know-how, ale stosunkowo małego zespołu ludzi, cyfrowe działania wywrotowe są znacznie prostsze do zaprojektowania, ale wymagają masy krytycznej użytkowników do upowszechniania narracji. Połączenie wszystkich tych technologii w spójną strategię zróżnicowaną taktycznie zostało skonceptualizowane jako” wojna hybrydowa”, albo – jeśli mieści się poniżej progu konfliktu zbrojnego – po prostu jako złośliwe działania.7

Wreszcie, przynajmniej do tej pory, sama przestrzeń kosmiczna była i jest stosunkowo odporna na te trendy, zarówno dzięki Traktatowi o przestrzeni kosmicznej z 1967 roku, jak i dzięki ryzyku, jakie nierozerwalnie związane jest z ewentualnym użyciem siły – na przykład w postaci gruzu kosmicznego. Tam na górze postęp technologiczny koncentruje się na ułatwianiu działalności tu na dole, głównie w postaci łączności satelitarnej do transmisji i nawigacji – zarówno dla podmiotów publicznych, jak i, w coraz większym stopniu, prywatnych, co skutkuje demokratyzacją technologii. Państwa o największym potencjale w rzeczywistości częściowo zmilitaryzowały kosmos, a teraz coraz więcej państw (także dzięki zmianom technologicznym) jest w stanie wejść do tej gry. Jednak, chociaż nie ma dobrze przetestowanych protokołów lub zasad zaangażowania w działania zbrojne tam na górze, przystosowanie zasobów bazujących w kosmosie do wykorzystania jako broń nadal wydaje się miało prawdopodobnym scenariuszem.8

Inteligentne urządzenia i ich zakres

Oto nadchodzi sztuczna inteligencja (SI), uczenie maszynowe i autonomia urządzeń (komputery kwantowe może są odrobinę dalej na horyzoncie, chociaż mogą okazać się nie mniej destrukcyjne). Koncepcja sztucznej inteligencji datuje się od wczesnych lat pięćdziesiątych, ale postęp technologiczny był wtedy bardzo powolny, aż do ostatnio minionej dekady. Wtedy zaszły trzy główne zmiany: miniaturyzacja procesorów zwielokrotniła siłę obliczeniową, upowszechnienie się mobilnych i połączonych narzędzi umożliwiło generację ogromnej masy danych i wreszcie zastosowanie nowych rodzajów algorytmów wykorzystujących skokowe postępy w uczeniu maszynowym (zwłaszcza sieci neuronowych) zwiększyły całkowity potencjał maszyn.9

X-47B bojowy bezzałogowy aparat latający stworzony przez Northrop Grumman we współpracy z Agencją Zaawansowanych Obronnych Projektów Badawczych Departamentu Obrony USA, jest półautonomiczny. (Dzięki uprzejmości Northrop Grumman).

W obszarze zdrowia publicznego i diagnostyki, np. w badaniach nad nowotworami, wspomniany postęp technologiczny już teraz pokazuje swoją wartość i korzyści z nim związane nie podlegają dyskusji. Jednak w dziedzinie bezpieczeństwa i obrony werdykt jeszcze nie zapadł – zwłaszcza pespektywa całkowicie autonomicznego systemu uzbrojenia wzbudziła liczne obawy o charakterze etycznym, prawnym i operacyjnym.

„Autonomia” w odniesieniu do systemów uzbrojenia jest pojęciem spornym na poziomie międzynarodowym, podatnym na różne interpretacje poziomu jej akceptowalności. Wynikająca stąd debata doprowadziła, między innymi, do powstania w 2016 roku grupy rządowych ekspertów ds. śmiercionośnych autonomicznych systemów uzbrojenia (LAWS) przy ONZ. Jednak grupa ta nie doszła jeszcze do uzgodnionych wniosków. Po części wynika to z obecnych warunków strategicznych oraz geopolitycznego wymiaru technologii, gdzie niektóre państwa rozwijające te systemy nie są zainteresowane wprowadzeniem regulacji oraz wierzą, że nadal mogą zdobyć przewagę konkurencyjną nad innymi. Jednak wynika to także z tego, iż „autonomia” jest względnym pojęciem.

Niewielu analityków zaoponuje, że w zagrożonym środowisku taktycznym pewien poziom autonomii jest kluczowy, aby platformy bezzałogowe pozostały realnym narzędziem operacyjnym. Co więcej, autonomiczne systemy uzbrojenia istnieją od dawna (np. miny lądowe), a zautomatyzowane systemy są już wykorzystywane dla celów cywilnych oraz do ochrony sił zbrojnych, od izraelskiego systemu obrony przeciwrakietowej - Żelaznej Kopuły – po artylerię okrętową wykorzystującą czujniki. Z bardzo niewieloma wyjątkami, współczesne systemy uzbrojenia są w najlepszym razie półautonomiczne. Co więcej, z reguły są one niezwykle drogie, a przez to mało dostępne kosztowo.

Czynniki technologiczne i operacyjne nadal ograniczają ewentualne zastosowanie śmiercionośnych autonomicznych systemów uzbrojenia (LAWS): chociaż angażowanie e celów staje się coraz łatwiejsze, ryzyko błędnej kalkulacji, eskalacja oraz brak odpowiedzialności wydają się przemawiać za znaczącą kontrolą ze strony człowieka – wszystkie wymienione czynniki podważają ustalone międzynarodowe normy i prawa konfliktu zbrojnego. Jednak pozostaje także pokusa, aby wykorzystać tymczasową przewagę technologiczną i przeprowadzić pierwsze uderzenie i nie wszystkie liczące się podmioty muszą koniecznie grać według tych samych zasad etycznych i prawnych.

Dodatkowo, poza tradycyjną sferą wojskową, ostatnie spektakularne przełomy w dziedzinie rozpoznawania głosu i rysów twarzy (mocno związane ze sztuczną inteligencją) mogą w dalszym stopniu zachęcać do działań wywrotowych, a projektowanie coraz bardziej zaawansowanego technicznie adaptywnego złośliwego oprogramowania może promować więcej działań sabotażowych. Te państwa, które mogą decydować o infrastrukturze i standardach wspierających takie działania uzyskają przewagę strategiczną.

Jednak, odzwierciedlając to, co już dzieje się w badaniach medycznych, sztuczna inteligencja może być wykorzystywana do wykrywania, rozpoznawania schematów oraz symulacji – a wszystkie te działania mogą być kluczowe dla zwalczania terroryzmu, ochrony cywilnej i reagowania w przypadku katastrof, a także do kontroli zbrojeń (monitorowania i weryfikacji). „Szyta na miarę” sztuczna inteligencja może w istocie zapewnić lepszą działalność wywiadowczą, świadomość sytuacyjną, analizy i prawdopodobnie także podejmowanie decyzji. Sztuczna inteligencja może też być wykorzystywana do praktycznych celów, już powszechnych w sektorze biznesu, jak skuteczna logistyka lub przewidujące utrzymanie i serwisowanie sprzętu, a wszystko to pełni bardzo ważną rolę w sferze wojskowej.

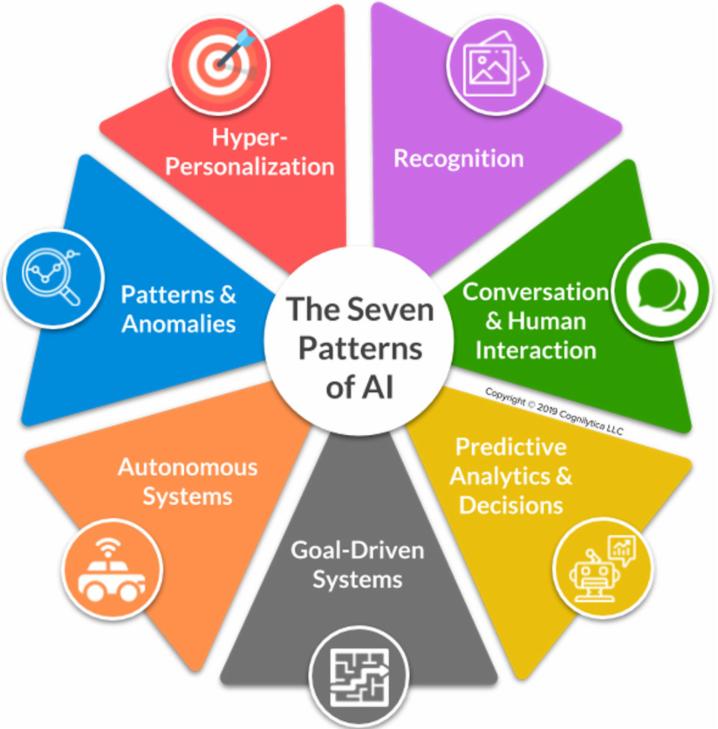

Wszystkie zastosowania sztucznej inteligencji wpisują się w siedem powszechnych schematów, wskazanych w tym diagramie © Cognilytica

Co więcej, większość ekspertów podkreśla ważne rozróżnienie w obrębie sztucznej inteligencji. Zatem wąsko rozumiana sztuczna inteligencja odnosi się do maszyn jednocelowych, to jest urządzeń, które mogą wykonywać unikalne zadania wyjątkowo dobrze w jednej dziedzinie, ale są prawie bezużyteczne w nieznanych sytuacjach, albo dla innych zastosowań. Z kolei, ogólna sztuczna inteligencja odnosi się do zdolności do wykonywania wielorakich i wielowymiarowych działań bez konkretnego programowania i uczenia ich w tym zakresie – uważa się, że ta wizja jest jeszcze bardzo odległa.

W przewidywalnej przyszłości zakres potencjalnych zastosowań wojskowych „wąskiej” sztucznej inteligencji wydaje się całkiem atrakcyjny. Jednak inwestycje będą zależeć do gotowości do ponoszenia finansowego ryzyka wobec ograniczonych budżetów publicznych i będą przeciwważone priorytetami w zakresie innej modernizacji i priorytetów operacyjnych. Tu również technologia może być zarówno błogosławieństwem, jak i przekleństwem, i nie jest nieprawdopodobne, że powtórzone zostaną schematy historyczne, w ramach których technologie zastępujące pracę ludzką spotykają się z większym sprzeciwem niż technologie, które ją umożliwiają.10

W przeszłości międzynarodowe wysiłki zmierzające do kontroli proliferacji, produkcji i rozwijania lub rozmieszczania konkretnych technologii wojskowych (od środków chemicznych, biologicznych, radiologicznych i nuklearnych, po miny lądowe, od oślepiających laserów, po systemy obrony przeciwrakietowej) były w różnym stopniu, inspirowane przez cztery odrębne, ale potencjalnie pokrywające się priorytety: etykę, prawomocność, stabilność i bezpieczeństwo. Ewentualne zastosowanie sztucznej inteligencji wzbudziło obawy we wszystkich tych czterech obszarach. W przeszłości także, wydawałoby się nieunikniony, wyścig zbrojeń w tych nowych dziedzinach był opóźniany lub wstrzymywany przez pewną instytucjonalizację norm – w większości uzgodnionych już po tym, jak technologie te osiągnęły jakąś dojrzałość, a często miały zaawansowaną formę. Normy te były inspirowane i często formułowane przez społeczności ekspertów (z rządu i/lub środowisk akademickich).

Jednak, jako technologia o ogólnym zastosowaniu, sztuczna inteligencja jest całkiem osobliwa, i tacy są eksperci zaangażowani w jej rozwój i zastosowania.11 Jednak zachęcające jest spostrzeżenie, że znacząca liczba państw (np. w ramach OECD – Organizacji Współpracy Gospodarczej i Rozwoju), a także przedsiębiorstwa takie jak IBM, Microsoft i Google ostatnio opowiedziały się za wspólnym kodeksem postępowania w zakresie sztucznej inteligencji – lub nawet publicznie sformułowały własne zasady – zwłaszcza w odniesieniu do jej wojskowych i etycznych implikacji. Zrobił tak między innymi Pentagon.

Innymi słowy, ryzyko wyścigu zbrojeń w obrębie tych rodzących się technologii bez wątpienia istnieje, podobnie jak ogólniejsze zagrożenie – o którym mówili między innymi Henry Kissinger, Stephen Hawking i Elton Musk. Są nim niezamierzone konsekwencje masowego i bezrefleksyjnego stosowania sztucznej inteligencji. Istnieje także nadzieja, że takie technologie mogą być ukierunkowane na realizację mniej destruktywnych aplikacji i skończą podobnie jak gaz trujący i broń przeciwsatelitarna – najpotężniejsze państwa powstrzymają się od wzajemnych ataków, a inne, przynajmniej militarnie, słabsze państwa oraz podmioty niepaństwowe mogą wciąż podejmować ataki, ale ich skuteczność jest znikoma.